Штучний Інтелект – це добре чи погано для бізнесу?

ChatGPT та інші широкомовні моделі (LLM) викликали « цунамі » інтересу підприємств до штучного інтелекту (ШІ), причому минулого року майже три з чотирьох компаній пілотували генеративні інструменти ШІ для важливих випадків використання. Однак підприємства не єдині, хто зацікавлений у ШІ. Зловмисники використовують генеративний штучний інтелект для персоналізації атак, використовуючи компрометацію бізнес-електронної пошти (BEC), фішинг, уособлення голосу та інші види шахрайства, щоб змусити співробітників виконувати несанкціоновані дії, такі як надсилання банківських переказів несанкціонованим банкам або одержувачам. І сітуація з цими атаками лише погіршується.

Автор подкасту Device42 « Автостопом до ІТ» Мішель Доун Муні запитала Майка Сейлора, генерального директора Blackswan Cybersecurity і професора кібербезпеки Техаського університету в Сан-Антоніо, про нові стратегії атак на основі ШІ, та як уникнути жертв.

Почнемо з того, що Сейлор має диплом з кримінального правосуддя і зараз закінчує докторську. Він 30 років працював у сфері ІТ та кібербезпеки, та 24 роки викладав інформатику та кіберкриміналістику. Сейлор сказав, що йому подобається навчати інших про кіберризики, щоб вони могли захистити себе від новітніх стратегій і методів атак.

Обговорення походження ШІ

Штучний Інтелект сьогодні вже не нова технологія – компанії розгортають моделі машинного навчання (ML) і використовують їх для оптимізації прийняття рішень та інших процесів.

ML — це інструмент, заснований на поведінці, який використовує базову лінію для визначення відхилень. Організації використовували ML для покращення логістики та маршрутизації автопарку польового обслуговування, виявлення моделей злочинності в громадах, підвищення задоволеності клієнтів, підвищення операційної ефективності, зменшення відходів продукції та досягнення інших цілей. Таким чином, передбачення моделі ML представляють значне вдосконалення в порівнянні з формулами обчислення в електронній таблиці.

За словами Сейлора, ШІ – це застосування машинного навчання. Моделі ШІ можуть надавати описові можливості, аналізуючи минулі тенденції, мають можливості прогнозування, передбачення того, що ймовірно станеться і директивні можливості, надаючи сценарії та рекомендації, які користувачі можуть реалізувати.

«Але так само, як і машинне навчання, штучний інтелект ґрунтується на тілі знань, які вже існують. Наступна еволюція буде ще страшнішою, оскільки вона створить нові речі. Але ми ще не там», — сказав Сейлор.

Корисні застосування ШІ

Спочатку поговоримо про позитивне застосування штучного інтелекту перед тим, як заглибитися в деякі з його більш злі моделі застосувань.

Команда Сейлора використовувала ШІ та ML, щоб розрізнити хорошу та погану поведінку в клієнтських мережах. Він навів приклад сповіщень про кібербезпеку, які сповіщають користувачів про те, що їхні облікові записи електронної пошти зламано. Подібним чином ML і ШІ допомагають компаніям випереджати зловмисників, виявляючи зловмисну активність, яка має відбутися.

«З військової точки зору ми називаємо це відходом від буму, випередженням вибуху, загрозою або компромісом», — сказав Сейлор. Для цього команди з кібербезпеки підприємства повинні збирати багато даних, обробляти та зберігати їх, а також виконувати аналітику.

Коли користувачі шукають у щось Google, вони навчають ШІ пошукової системи ставати розумнішим, оскільки моделі оцінюють, що люди шукають і їхню поведінку в Інтернеті.

Подібним чином команди з кібербезпеки використовують аналітику поведінки, розробляють базові показники відомої належної поведінки та починають пошук відхилень — незалежно від того, чи поведінка машини, користувача, мережі, програми, чи пошуку. Роблячи це, команди можуть випереджати викриття.

Як зловмисники використовують ШІ

Генеративний штучний інтелект полегшив роботу багатьох систем для більшої кількості людей, незалежно від того, чи це, наприклад, студенти використовують ChatGPT, щоб писати роботи та обманювати завдання, чи зловмисники, які маніпулюють технологіями. Крім того, занадто багато людей сприймають генеративні результати ШІ як правду, не перевіряючи, чи точні дані.

«Це страшно, тому що я вважаю, що величезна кількість людей дуже довіряє цій технології без перевірки, і це недоречна», — каже Сейлор через схильність генеративного ШІ викривляти факти.

Як хакери використовують штучний інтелект для компрометації бізнес-електронної пошти

Зловмисники використовують такі методи, як BEC, який передбачає отримання облікових даних особи, яка займається фінансовими операціями компанії. Вони можуть зв’язатися з якимось співробітником, чи навіть секретарем, а потім використати соціальну інженерію, щоб з’ясувати, хто займається фінансами, будь то бухгалтер чи клерк із кредиторської заборгованості, фінансовий директор чи генеральний директор компанії.

«Погані хлопці … мають весь час світу. Вони не мають денної роботи. Вони прокидаються, коли хочуть, і виконують стільки роботи, скільки хочуть, і роблять це сім днів на тиждень. І тому можуть пройти місяці чи роки, перш ніж вони досягнуть того, хто їх цікавить, і вони витратят час, щоб зробити це», – сказав Сейлор. Ці люди часто діють у злочинних угрупованнях або великих групах, які фінансуються національними державами.

Отримавши доступ до потрібної особи, зловмисник надішле електронний лист і використає повноваження та терміновість, щоб змусити цю особу виконати транзакцію. Наприклад, хакер може видати себе за генерального директора на сторонньому сайті та недоступний по телефону, вимагаючи, щоб клерк здійснив велику транзакцію. Зловмисник може заволодіти обліковим записом генерального директора або надіслати електронний лист із схожого за звучанням домену, щоб службовець не помітив різниці.

Якщо службовець надсилає електронний лист, зловмисник відповідає та підтверджує запит. Тоді клерк здійснює транзакцію, не розуміючи, що вона шахрайська.

BEC зростає в масштабах і тяжкості. Федеральне бюро розслідувань США стверджує, що BEC становить глобальну проблему на 50 мільярдів доларів із майже 280 тисячами задокументованих випадків. У зв’язку з цим деякі компанії тепер мають політику, яка забороняє персоналу здійснювати значні фінансові операції через інструкції електронною поштою. Замість цього одержувачі мають зробити телефонний дзвінок або фізично пройти коридором і підтвердити запит від ініціатора.

Отже, як зловмисники використовують штучний інтелект для BEC, фішингових електронних листів та іншого шахрайства? Багато зловмисників працюють за кордоном, і англійська не є їх рідною мовою. Вони використовують Google Translate для створення електронних листів, що призводить до поганої граматики, неправильних часів дієслів чи займенників, поганого форматування або дивних тонів. Тоді користувачам легше виявити ці електронні листи та зрозуміти що вони шахрайські. У результаті шахрайство, яке раніше було успішним на 80%, зараз досягає позначки лише в 60% випадків, сказав Сейлор.

Тепер шахраї можуть попросити інструменти штучного інтелекту написати фішингові електронні листи голосом 50-річного генерального директора, який навчався в Гарварді, або когось, хто виріс на Півдні. Інструмент штучного інтелекту навіть може використовувати контент, створений цільовим користувачем раніше, наприклад блоги або публікації в соціальних мережах, щоб імітувати їх тон і мову. У результаті ці електронні листи здаються набагато більш достовірними, ніж їхні попередники, створені Google Translate.

Отже, як щодо політики компанії, яка вимагає від тих, хто затверджує транзакції, телефонувати своїм ініціаторам? Інструменти штучного інтелекту можуть відбирати голоси людей із будь-якого відео чи публікації в Інтернеті. Погані хлопці можуть взяти уривок чийогось голосу і створити цілий двогодинний фільм, який звучить як голос тієї людини, сказав Сейлор. Ці шахраї також можуть використовувати його для розмов у реальному часі голосом своєї цілі.

У результаті контроль безпеки, який вимагає від одержувача електронної пошти підтвердити фінансовий запит за допомогою телефонного дзвінка, більше не працює. «Це має бути зроблено особисто, віч-на-віч. І я не маю на увазі віч-на-віч із камерою, тому що штучний інтелект також може видати себе за мене», — сказав Сейлор.

Як компанії можуть захистити працівників та їхній бізнес в епоху ШІ

Ведуча Муні попросила Сейлора дати слухачам вказівки щодо захисту їхніх компаній і робочих місць. Вона зазначила, що працівників звинувачують і працівники можуть втратити роботу, якщо вони не дотримуються належних протоколів для виявлення та запобігання шахрайству. Отже, що люди можуть зробити, щоб бути більш проактивними?

Сейлор сказав, що більше 20 років вчився зламувати різні ресурси, включаючи банки, електростанції, колекторські компанії та виробничі потужності, і зараз має 100% успіх у цій справі. Тепер Сейлор перевіряє засоби безпеки компаній, щоб побачити, чи зможе він переконати працівників підірвати їх.

Він і його команда знімають відео та аудіо цих навчань, де він використовує тактику, як-от прикидаючись інспектором з вогнегасників, щоб отримати доступ до об’єктів. Після порушення конфіденційності об’єктів, Сейлор проведе підведення підсумків і покаже командам, чого вони не зробили, наприклад, запитали посвідчення особи, зателефонували на номер його передбачуваної інспекційної компанії або передали запит начальнику.

Тож яуі поради від Сейлора можна дати?

Виграйте час: Сейлор сказав, що одна з найважливіших речей, які люди можуть зробити, це уповільнити темп, ігнорувати терміновість і повністю розглянути запит. Наприклад, чи є сенс, щоб генеральний директор компанії надсилав електронний лист посеред ділової зустрічі та відмовлявся відповідати на дзвінок? Чи логічно, що хтось із членів родини одержувача електронної пошти потрапив у біду, а рішення полягає в тому, щоб купити їм подарункові картки Apple? Чи можна довіряти тому, що хтось, з ким працівник ніколи не спілкувався, тепер покладається на них у виконанні чогось важливого? Якщо ні, тоді запит вимагає подальшого вивчення.

Передайте запит вищестоящому керівнику: одержувач електронної пошти може залучити інших, наприклад керівника або експерта з безпеки, до оцінки запиту, щоб визначити, чи він законний.

Спробуйте зв’язатися з ініціатором іншим способом: не використовуйте контактну інформацію, надану запитувачем, таку як електронні адреси, веб-сайти та номери телефонів. Використовуйте інші канали для зв’язку з ймовірним ініціатором акції. Наприклад, мати може захотіти зателефонувати дочці, яка повідомляє про те, що у неї проблеми, перш ніж надсилати гроші. Вона також може зв’язатися зі своїми друзями чи вчителями, якщо не зможе зв’язатися з донькою.

Відповідальне використання даних і ШІ

А які поради можна дати працівникам щодо того, як компаніям зберігати та використовувати дані клієнтів, які вони використовують для навчання моделей ШІ?

Перш ніж використовувати ШІ, працівники повинні визначити, до яких моделей даних мають доступ, як дані використовуються для навчання моделей і як використовуються самі моделі. Зрозуміло, що методи використання відрізнятимуться залежно від того, чи є рішення загальнодоступним, використовує зовнішні чи внутрішні дані, а також використовує особисту інформацію клієнта (PII) та інші конфіденційні дані.

Компанії вже дотримуються правил, які регулюють використання даних у бізнес-процесах. Тепер вони повинні переконатися, що дані, які споживає ШІ, відповідають їхнім корпоративним цілям і нормативним обмеженням. Наприклад, організації охорони здоров’я, які використовують штучний інтелект для розробки ліків від раку, можуть заповнювати його тематичними дослідженнями, історіями пацієнтів і записками лікаря. Як наслідок, вони захочуть зберігати дані та моделі використання всередині, лише для дослідницьких цілей, а не оприлюднювати цю інформацію. Як знають користувачі таких інструментів, як ChatGPT, питання, які вони вводять у ці LLM, додають до корпусу знань, до якого інші можуть отримати доступ.

Розробники рішень штучного інтелекту повинні вирішувати ці проблеми заздалегідь, а не заднім числом, щоб усунути ризики. Крім того, впровадження безпеки в рішення після їх розробки коштує значно дорожче, ніж підхід до проектування DevSecOps.

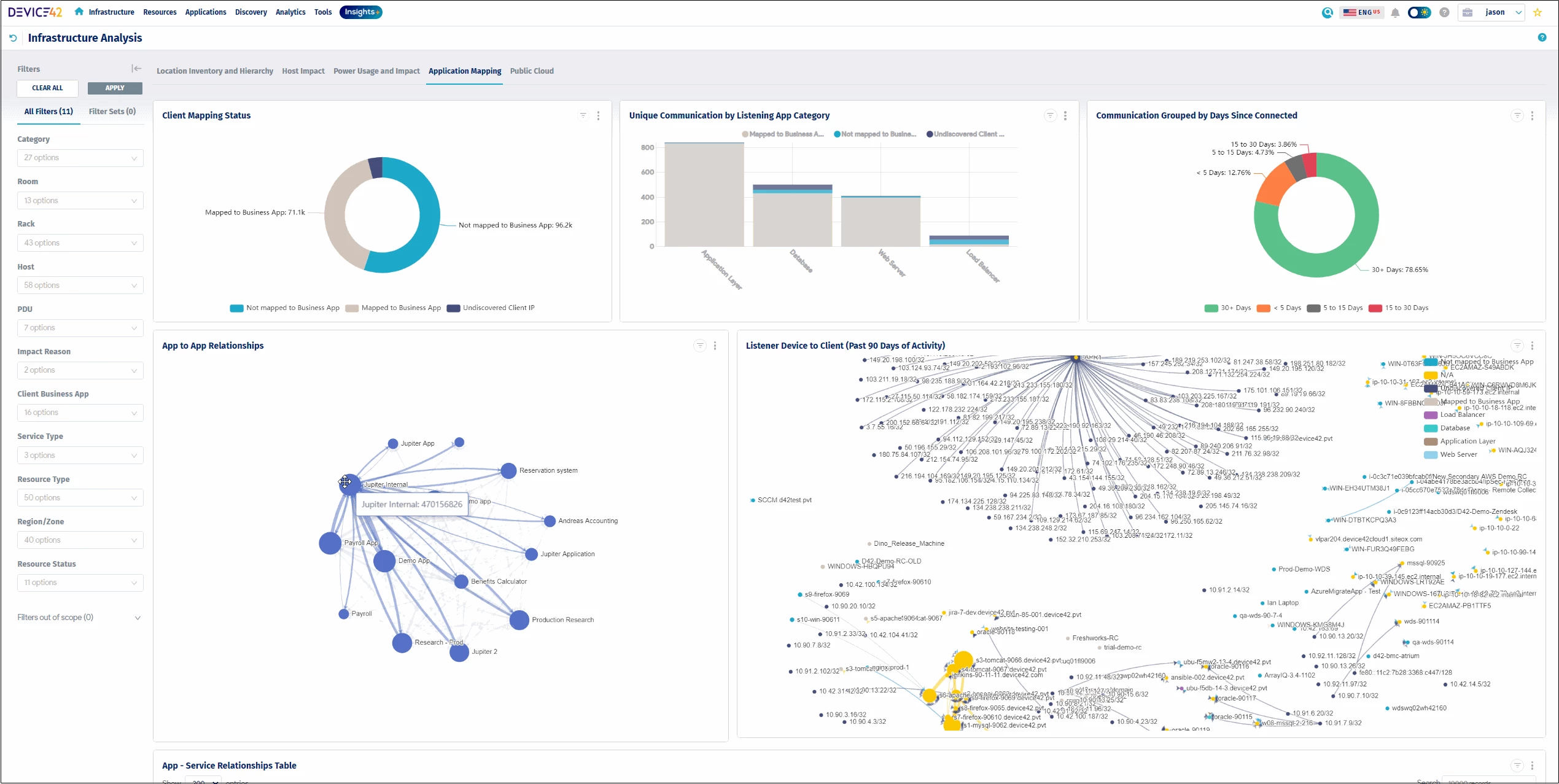

На закінчення пояснимо чому ведуча мала бесіду саме з Сейлором. Пояснення дуже просте. Саме інспектував використання ШІ у програмних рішеннях Device42. Взагалі Device42 надає комплексні можливості керування ІТ- активами, включаючи потужне автоматичне виявлення активів і конфігуровані типи активів для повного документування всіх ІТ- активів у вашої інфраструктурі.

Програмні рішення Device42 використовують штучний інтелект (ШІ) кількома способами, щоб забезпечити безпеку та ефективність ІТ-інфраструктури. Ось деякі приклади:

Аномальне виявлення: ШІ використовується для аналізу даних з пристроїв та мереж для виявлення аномальної поведінки, яка може свідчити про кібер-атаку. Це може включати такі речі, як раптовий сплеск трафіку, незвичайні запити до даних або спроби проникнення. ШІ може виявляти ці аномалії значно швидше, ніж люди, що дозволяє швидше реагувати на загрози.

Автоматизація завдань: ШІ використовується для автоматизації повторюваних завдань, таких як оновлення програмного забезпечення, налаштування конфігурацій та перевірки безпеки. Це звільняє час ІТ-персоналу для більш складних завдань, а також допомагає гарантувати, що ці завдання виконуються послідовно та без помилок.

Прогнозна аналітика: ШІ використовується для аналізу історичних даних, щоб прогнозувати майбутні проблеми. Це може допомогти ІТ-персоналу вжити превентивних заходів для запобігання проблемам до їх виникнення.

Персоналізація: ШІ використовується для персоналізації досвіду користувачів, надаючи їм інформацію та рекомендації, які їм найбільше підходять. Це може допомогти покращити продуктивність користувачів та зменшити їхню залежність від ІТ-підтримки.

Прозорість: Device42 надає користувачам інформацію про те, як використовується ШІ, та про те, які дані збираються та використовуються.

Контроль: Користувачі мають можливість контролювати те, як їхні дані використовуються, та відмовлятися від використання ШІ.

Підзвітність: Device42 несе відповідальність за використання ШІ та вживає заходів для пом’якшення ризиків.

Більш детальну інформацію про рішення Device42 можна отримати у офіційного партнера – компанії Ідеалсофт.